Jak wygląda pobieranie elementów przez roboty?

Pobieranie elementów przez roboty oznacza dwa światy – fizyczny bin picking w produkcji i cyfrowy web scraping w systemach RPA oraz skryptach automatyzacji. W obu przypadkach robot musi rozpoznać obiekt, ocenić dostępność i wykonać ruch bez błędu. Jeśli chcesz dobrać właściwe narzędzia i uniknąć typowych awarii, ten tekst przeprowadzi Cię przez temat krok po kroku.

Najważniejsze informacje z tego artykułu:

- Robot może pobierać zarówno elementy fizyczne, jak i dane z witryn internetowych.

- Bin picking opiera się na wizyjnym rozpoznaniu obiektów i planowaniu chwytu.

- Web scraping działa na HTML, API, renderowaniu dynamicznym i OCR.

- Wydajność zależy od jakości detekcji, planowania ruchu i ograniczenia błędów.

- Bezpieczeństwo strony wymaga kontroli ruchu, limitów i ochrony warstwy aplikacji.

Co oznacza pobieranie elementów przez roboty?

Pobieranie elementów przez roboty to automatyczne rozpoznanie, wybór i przejęcie konkretnego obiektu lub danych z większego zbioru. Ten sam schemat działa w hali produkcyjnej i w środowisku cyfrowym. Robot przemysłowy wybiera detal z pojemnika, a bot, skrypt albo narzędzie RPA pobiera dane z HTML, API, dokumentu lub aplikacji internetowej.

Mechanizm pozostaje wspólny: system najpierw wykrywa kandydatów, potem ocenia ich przydatność, a na końcu wykonuje chwyt, ruch albo zapytanie. Gdy zawiedzie którykolwiek etap, pojawia się błędny pobór, kolizja, pusty rekord albo niepotrzebna zwłoka.

- Wykrycie obiektu lub danych.

- Ocena położenia, kształtu albo struktury.

- Wybór elementu do pobrania.

- Planowanie ruchu, chwytu lub zapytania.

- Wykonanie pobrania i potwierdzenie sukcesu.

Właśnie dlatego pobieranie elementów przez roboty nigdy nie sprowadza się do samego chwytu albo samego kliknięcia. Liczy się cały łańcuch decyzyjny. Z mojego doświadczenia wynika, że najwięcej problemów zaczyna się tam, gdzie ktoś zbyt wcześnie skupia się na narzędziu, a zbyt późno definiuje, co dokładnie robot ma znaleźć i po czym ma poznać sukces.

Wskazówka: najpierw opisz element docelowy, warunki odrzucenia i sposób potwierdzenia pobrania, a dopiero potem dobieraj kamerę, bibliotekę, selektor albo chwytak.

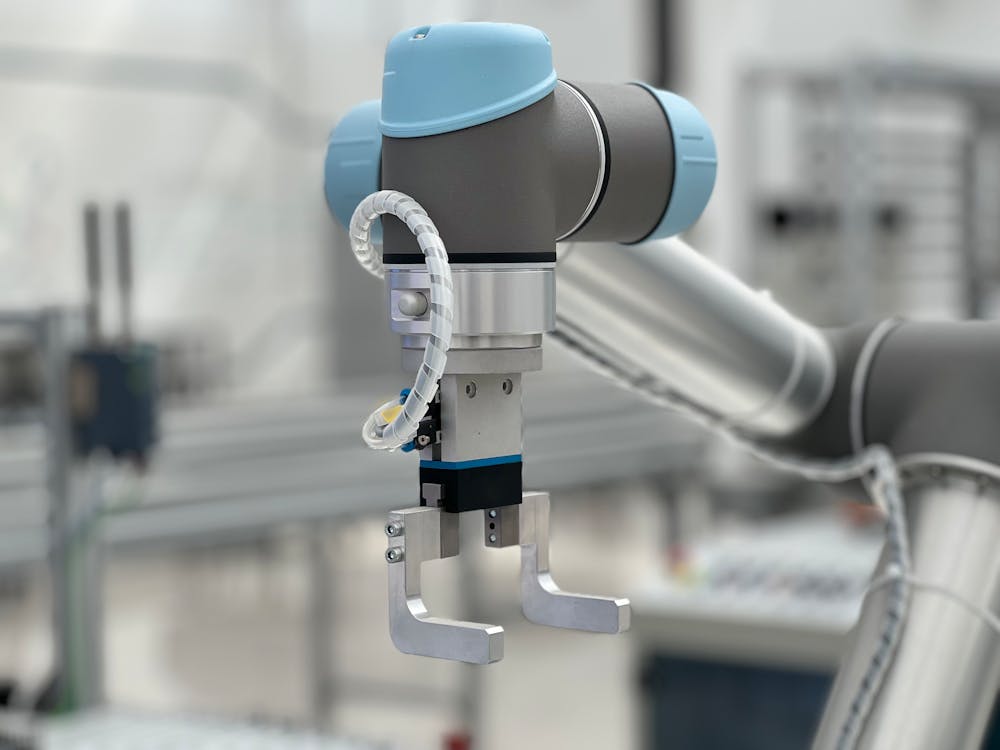

Jak działa pobieranie elementów w bin picking?

Bin picking polega na tym, że robot rozpoznaje losowo ułożone detale w pojemniku i wybiera taki, który da się pobrać bez kolizji. To ważne rozróżnienie. Robot nie chwyta pierwszego widocznego elementu, tylko ten, który spełnia warunki chwytalności i mieści się w bezpiecznej trajektorii.

- Pobierz obraz 3D z kamery i zbuduj chmurę punktów.

- Odfiltruj szum, odbicia i punkty tła.

- Wykryj kandydatów do chwytu na podstawie modelu CAD lub reguł rozpoznawania.

- Oceń chwytalność, uwzględniając geometrię, zakrycie i dostęp narzędzia.

- Wyznacz trajektorię robota z pominięciem kolizji z krawędzią skrzyni i sąsiednimi detalami.

- Wykonaj chwyt i potwierdź, że detal rzeczywiście opuścił pojemnik.

Za tym procesem stoją trzy warstwy: percepcja, czyli rozpoznanie obiektu, estymacja chwytu, czyli obliczenie punktu i sposobu uchwycenia, oraz planowanie ruchu, które prowadzi ramię po trajektorii bezkolizyjnej. W praktyce właśnie na styku tych warstw ujawniają się ograniczenia systemu.

W rozwiązaniach takich jak KUKA.SmartBinPicking kamera 3D Roboception generuje chmurę punktów otoczenia, a algorytmy AI wraz z planerem ruchu RRT* wyznaczają chwyt i trasę robota. Taki układ priorytetyzuje najbardziej dostępny detal, ogranicza zbędne przejazdy i pozwala zejść z cyklem pobrania nawet poniżej 5 sekund na pojedynczy pick bez kontaktu z krawędzią skrzyni.

W systemach Festo bin picking rozpoznanie obiektów opiera się na fuzji danych, czyli łączeniu informacji z kilku sensorów, na przykład kamer stereo i lidarów. Dzięki temu system buduje model 6D pose, czyli pozycję i orientację detalu w przestrzeni. Dla nieregularnych kształtów AI ocenia chwytalność przez symulację sił ssania albo chwytu palcowego i koryguje trajektorię w czasie rzeczywistym. To robi różnicę zwłaszcza przy kołach zębatych, blachach i detalach refleksyjnych.

W bardziej wymagających aplikacjach kamera ToF, czyli time-of-flight, tworzy mapę głębokości z rozdzielczością rzędu 1 mm. Gdy obiekt pozostaje częściowo zasłonięty, segmentacja instancji, na przykład Mask R-CNN, pozwala nadal odszukać jego granice i przewidzieć punkty chwytu. To właśnie tutaj bin picking przestaje być prostą automatyką, a zaczyna przypominać zaawansowaną percepcję maszynową.

Wskazówka: przy detalach o ostrych krawędziach, dużej refleksyjności albo zmiennej orientacji najpierw wykonaj testy chwytalności i testy oświetlenia, a dopiero później skracaj cykl produkcyjny.

Jakie technologie wspierają roboty w pobieraniu elementów?

Skuteczne pobieranie elementów przez roboty opiera się na sensorach, algorytmach decyzyjnych, narzędziach wykonawczych i warstwie integracyjnej. W świecie przemysłowym dominują kamery 3D, systemy stereo, lidary, kalibracja ręka-oko, chwytaki i planery trajektorii. W świecie cyfrowym podobną rolę pełnią parsery HTML, API, headless browsery, OCR i mechanizmy obsługi sesji.

| Narzędzie | Zastosowanie | Mocna strona | Ograniczenie |

|---|---|---|---|

| Kamery 3D i stereo | Bin picking | Dokładna lokalizacja detalu | Wrażliwość na odbicia i zabrudzenia |

| Chwytaki pneumatyczne i adaptacyjne | Chwyt fizyczny | Szybki cykl i prosty serwis | Ograniczona elastyczność geometrii |

| RRT* i planery ruchu | Omijanie kolizji | Bezpieczna trajektoria | Większe wymagania obliczeniowe |

| Puppeteer | Dynamiczny web scraping | Obsługa stron z JavaScript | Wyższy koszt uruchomienia niż parsowanie HTML |

| OCR | Odczyt tekstu z obrazu | Pobieranie danych z grafik i skanów | Spadek skuteczności przy słabej jakości obrazu |

| API | Bezpośrednie pobieranie danych | Porządek, szybkość i stabilność | Wymaga dostępu i zgodności z regulaminem |

W robotyce przemysłowej duże znaczenie ma też kalibracja ręka-oko, czyli matematyczne powiązanie układu współrzędnych kamery z układem robota. Bez tego nawet dobra detekcja nie przełoży się na celny chwyt. W rozwiązaniach edge computing, na przykład z modułami NVIDIA Jetson, analiza obrazu i korekta ruchu odbywają się blisko linii, bez zbędnych opóźnień. Przy zakłóceniach, takich jak drgania stanowiska, system może przeplanować chwyt niemal od razu.

W aplikacjach z podajnikami wibracyjnymi lub taśmowymi dochodzą encodery, czujniki laserowe i synchronizacja picku w locie. Dla śrub M3–M12 dobrze ustawiony podajnik potrafi orientować detale z powtarzalnością 99,9%, choć przy zmianie geometrii elastyczność układu szybko spada. To uczciwe ostrzeżenie: automatyzacja daje szybkość, ale nie lubi przypadkowości konstrukcyjnej.

W logistyce widać, jak mocno ten obszar przyspiesza. W 2018 roku na świecie wdrożono 111 tys. robotów do zastosowań logistycznych, co oznaczało wzrost o 60% rok do roku. Wartość rynku robotyki dla logistyki wzrosła wtedy z 2,4 do 3,7 mld USD, a prognozy wskazywały wzrost sprzedaży do 298 tys. sztuk i 30 mld USD do 2022 roku. Te liczby nie są ozdobnikiem. Pokazują, że pobieranie, transport i selekcja elementów stały się jednym z najszybciej rozwijanych obszarów robotyzacji.

Wskazówka: gdy istnieje wybór między API a parsowaniem HTML, sięgnij po API. Struktura danych jest wtedy stabilniejsza, utrzymanie prostsze, a liczba awarii mniejsza.

Jak zaprogramować robota do precyzyjnego pobierania elementów?

Precyzyjne programowanie robota zaczyna się od rozdzielenia zadania na trzy warstwy: percepcję, decyzję i wykonanie. Taki podział działa zarówno dla ramienia przemysłowego, jak i dla scrapera lub procesu RPA. Bez niego system szybko zaczyna działać pozornie poprawnie, a później trudno ustalić, gdzie naprawdę pojawia się błąd.

- Zdefiniuj element docelowy bardzo precyzyjnie.

- Sprawdź, czy źródło danych lub obiekt ma stabilną strukturę.

- Dobierz czujniki, bibliotekę lub chwytak do geometrii zadania.

- Ustal reguły odrzucania błędnych kandydatów.

- Zaimplementuj potwierdzenie pobrania, a nie tylko próbę pobrania.

- Dodaj logi, aby później zobaczyć, gdzie proces się zatrzymał.

W bin picking punkt wyjścia stanowi model obiektu, tolerancja położenia, kalibracja układu współrzędnych i definicja strefy pobrania. Potem dochodzą reguły priorytetu, na przykład wybór detalu najlepiej odsłoniętego lub najbliższego osi chwytaka. W scrapingu i RPA odpowiednikiem tych ustawień są selektory CSS lub XPath, logika paginacji, obsługa sesji, limity zapytań, retry i walidacja danych po pobraniu.

Najczęstszy błąd? Program przewiduje samą próbę pobrania, ale nie potwierdza jej skutku. Tymczasem skuteczny system zawsze sprawdza rezultat: czy detal opuścił pojemnik, czy rekord zawiera wymagane pola, czy odpowiedź serwera ma poprawny status, czy dane mieszczą się w oczekiwanym schemacie.

W praktyce bardzo pomaga zasada, którą stosuję regularnie: robot nie zgaduje, tylko weryfikuje stan źródła przed każdym ruchem albo pobraniem danych. To wydłuża etap projektowania, ale później oszczędza zaskakująco dużo czasu na debugowaniu.

Jak wygląda konfiguracja robota przemysłowego?

Konfiguracja robota przemysłowego obejmuje kalibrację, ustawienie stref pobrania, dobór chwytaka i weryfikację trajektorii pod kątem kolizji. Wiele wdrożeń gubi wydajność nie na samym chwytaniu, lecz na zbędnych przejazdach, złej geometrii podejścia albo błędnym układzie referencyjnym.

Najpierw wykonaj kalibrację ręka-oko. Potem porównaj położenie detalu wykryte przez kamerę z położeniem rzeczywistym. Następnie sprawdź margines bezpieczeństwa przy krawędziach pojemnika, sąsiednich detalach i elementach osprzętu. Na końcu testuj przypadki trudne: częściowe zakrycie, odbicia światła, zmienną orientację, drgania linii.

W rozbudowanych stanowiskach dochodzi integracja z PLC, na przykład Siemens S7-1500, oraz komunikacja z innymi urządzeniami przez OPC UA. Przy blachach i elementach długich robot 6-osiowy może współpracować z robotem mobilnym AGV: jeden realizuje precyzyjny chwyt próżniowy z kompensacją deformacji, drugi przejmuje transport między strefami. Taki podział zadań wyraźnie porządkuje proces i skraca przestoje.

Jak skonfigurować skrypt RPA lub scraper?

Konfiguracja skryptu RPA lub scrapera polega na ustawieniu odpornych selektorów, obsłudze sesji, kontroli tempa żądań i walidacji danych po pobraniu. Sam selektor, nawet poprawny, nie wystarczy. Strona może ładować treść dynamicznie, wymagać logowania albo zwracać różne odpowiedzi zależnie od kontekstu sesji.

- Selektory CSS lub XPath.

- Obsługę ciasteczek i sesji.

- Limit równoległych żądań.

- Mechanizm ponownych prób.

- Walidację danych po pobraniu.

Dobrze działający scraper zapisuje kod odpowiedzi serwera, treść błędu, moment wykonania żądania i informacje o tym, czy strona renderowała dane po JavaScript. Przy aplikacjach dynamicznych headless browser, na przykład Puppeteer, daje dużą elastyczność, ale kosztuje więcej zasobów niż zwykły parser HTML. Dlatego pełne renderowanie ma sens wtedy, gdy prostsza ścieżka naprawdę nie działa.

Wskazówka: przy pobieraniu danych z aplikacji webowej zapisuj odpowiedź serwera i kod statusu. Sam brak elementu na stronie nie wyjaśnia jeszcze, czy zawiódł selektor, sesja, JavaScript czy blokada antybotowa.

Jakie błędy pojawiają się podczas pobierania elementów?

Najczęstsze błędy wynikają z błędnej identyfikacji obiektu, złej kalibracji, niestabilnego chwytu, kolizji ruchu, opóźnień renderowania albo zmiany struktury strony. Objawy są różne, ale źródła problemu zwykle powtarzają się zaskakująco często.

- Robot trafia w pustą przestrzeń albo w krawędź pojemnika.

- Detale wypadają z chwytaka podczas przenoszenia.

- Skrypt zbiera puste rekordy lub powtarza te same dane.

- Strona zwraca CAPTCHA, przekierowanie albo błąd 403.

- Cykl pobrania rośnie bez widocznej poprawy jakości danych.

W środowisku fizycznym problemy powodują śliskie powierzchnie, refleksy świetlne, zabrudzone sensory, błędna kalibracja i zbyt optymistyczna ocena chwytalności. W środowisku cyfrowym zawodzi dynamiczne ładowanie treści, zmiana klas CSS, wygasła sesja, limit API, niestabilny XPath albo brak synchronizacji z odpowiedzią serwera.

Diagnostykę najlepiej prowadzić w tej kolejności:

| Objaw | Prawdopodobna przyczyna | Co sprawdzić najpierw |

|---|---|---|

| Chwyt obok detalu | Błąd kalibracji lub detekcji | Układ współrzędnych, jakość chmury punktów, oświetlenie |

| Detal wypada | Zły punkt chwytu lub siła chwytaka | Parametry chwytaka, masę detalu, orientację |

| Puste dane w scraperze | Treść ładowana dynamicznie | Network, DOM po renderowaniu, odpowiedzi API |

| Błąd 403 lub CAPTCHA | Ochrona antybotowa | Tempo żądań, nagłówki, sesję, sposób logowania |

| Wydłużony cykl | Zbyt dużo operacji pośrednich | Liczbę przejazdów, retry, renderowanie całej strony |

Gdy problem wraca cyklicznie, najpierw sprawdź dane wejściowe. To praktyczna zasada, która regularnie oszczędza godziny pracy. Ruch robota albo logika scrapera często tylko ujawniają wcześniejszy błąd, a nie są jego pierwotną przyczyną.

Jak chronić stronę przed nieautoryzowanym pobieraniem elementów?

Skuteczna ochrona strony opiera się na kilku warstwach zabezpieczeń: kontroli ruchu, ochronie aplikacji, weryfikacji dostępu i analizie zachowania. Filtr po User-Agent nie zatrzyma dziś prawie nikogo. Agresywny bot zmieni nagłówki szybciej, niż administrator zdąży dopić kawę.

- Rate limiting na poziomie serwera i aplikacji.

- Weryfikację CAPTCHA tylko tam, gdzie ma to sens.

- Rotację i wygasanie tokenów dostępu.

- Monitoring anomalii w ruchu.

- Blokadę nietypowych wzorców pobierania danych.

Dobrą ochronę buduje połączenie limitów per IP, kontroli sesji, podpisywania żądań, krótkiego czasu życia tokenów i analizy wzorców nawigacji. Człowiek klika nieregularnie, zmienia tempo i popełnia drobne błędy. Bot działa równo, szybko i podejrzanie konsekwentnie. Właśnie tę różnicę system ochrony powinien wyłapywać.

Przy publicznym API najlepiej sprawdza się osobny klucz dla każdej integracji, jawne limity, monitorowanie nadużyć i możliwość szybkiego odcięcia konkretnego klienta bez wyłączania całej usługi. Przy stronach publicznych sens ma także segmentacja zasobów: co ma być indeksowane przez wyszukiwarki, a co wymaga ochrony na poziomie aplikacyjnym.

Najlepsze zabezpieczenia nie utrudniają normalnego korzystania z serwisu. To ważne, bo zbyt agresywna obrona potrafi zranić własny biznes skuteczniej niż sam scraper.

Jak przyspieszyć seryjne pobieranie elementów?

Przyspieszenie procesu polega na skróceniu czasu decyzji i ograniczeniu operacji, które nie przybliżają robota do poprawnego pobrania. W produkcji oznacza to mniej zbędnych ruchów i lepszy wybór celu. W środowisku webowym oznacza mniej renderowania, mniej przeładowań i mniej niepotrzebnych zapytań.

- Ogranicz zbędne przejazdy robota.

- Priorytetyzuj łatwo dostępne elementy.

- Używaj danych strukturalnych zamiast pełnego renderowania.

- Buforuj wyniki, jeśli źródło się nie zmienia.

- Zmniejsz liczbę zapytań pomocniczych.

W bin picking dobrze działa wybór detalu o najwyższej chwytalności zamiast kurczowego trzymania się kolejności wykrycia. Takie podejście skraca cykl, zmniejsza liczbę nieudanych chwytów i ogranicza ryzyko kolizji. Systemy Festo z AI osiągają cykl rzędu 3–8 sekund na pick, między innymi dzięki ocenie chwytalności oraz dostosowaniu parametrów do refleksyjnych powierzchni z użyciem wielospektralnego oświetlenia LED.

W aplikacjach cyfrowych największy zysk zwykle daje przejście z renderowania całej strony na pobieranie danych z endpointów JSON albo z API. Różnica potrafi być odczuwalna natychmiast. Znika ciężar pełnej przeglądarki, maleje liczba błędów związanych z DOM, a logika procesu staje się prostsza.

W logistyce wzrost wydajności naprawdę da się zobaczyć na liczbach. Roboty mobilne odpowiadały w 2018 roku za 41% sprzedaży robotów do logistyki i magazynowania, przy globalnej sprzedaży 422 tys. sztuk robotów. W systemie Ptaków roboty zbierają towary z ponad 32 tys. półek, zwiększając wydajność magazynu trzykrotnie. To pokazuje prosty wniosek: dobrze zaprojektowane pobieranie elementów przez roboty skaluje się tam, gdzie człowiek zaczyna przegrywać z powtarzalnością i tempem operacji.

Przy bardzo dużej skali pojawia się jeszcze jeden poziom optymalizacji: współpraca wielu robotów. Grupy robotów mobilnych wykorzystują shared perception, czyli współdzielony obraz otoczenia, oraz komunikację między maszynami. Jeden robot planuje sekwencję pobrań na podstawie globalnej mapy, a pozostałe realizują zadania bez wzajemnego blokowania się. Brzmi futurystycznie? Już nie. To zwykła inżynieria systemowa.

Jakie rozwiązania sprawdzają się w praktyce?

Najlepiej sprawdzają się rozwiązania dopasowane do typu elementu, zmienności otoczenia i wymaganego poziomu dokładności. Jeden zestaw narzędzi nie obsłuży równie dobrze śruby, cienkiej blachy, skanu faktury i dynamicznego portalu z logowaniem.

- Bin picking dla losowo wsypanych detali metalowych.

- Pick-and-place dla elementów długich i podatnych na deformację.

- Śledzenie taśmy z użyciem czujników i encoderów.

- Scraping danych katalogowych ze statycznych stron.

- Pobieranie treści z aplikacji z JavaScript i logowaniem.

- Odczyt danych z faktur, skanów i obrazów z pomocą OCR.

Dla losowo ułożonych detali metalowych dobrze wypadają systemy z kamerą 3D, planowaniem bezkolizyjnym i chwytakiem dopasowanym do geometrii części. Dla elementów długich, cienkich albo odkształcalnych lepiej działają chwytaki próżniowe z kompensacją ugięcia oraz dokładna kontrola toru ruchu. Przy śledzeniu taśmy ważniejsza od złożonej wizji bywa szybka synchronizacja z encoderem i czujnikiem obecności.

W środowisku cyfrowym kolejność wyboru zwykle wygląda rozsądnie tak: API, potem HTML, a pełna przeglądarka dopiero wtedy, gdy prostsze opcje zawodzą. OCR zostaje na końcu, bo odczyt tekstu z obrazu bywa bardzo przydatny, ale jest bardziej podatny na szum, jakość skanu i błędy segmentacji.

W analizach dotyczących wykorzystania robotów w procesach logistycznych oraz stanu robotyzacji w Polsce i na świecie dobrze widać jedną prawidłowość: tam, gdzie proces pobierania ma powtarzalne reguły, jasny punkt odbioru i dobrze opisaną zmienność, wdrożenie idzie sprawniej, a zwrot z inwestycji pojawia się szybciej. Chaos na wejściu niemal zawsze wraca jako koszt po stronie utrzymania systemu.

Wskazówka: przed wdrożeniem uruchom testy na przypadkach trudnych: detalach zasłoniętych, stronach z opóźnionym renderowaniem, danych z brakami i obiektach o granicznej chwytalności. Właśnie tam widać realną odporność rozwiązania.

Jak sprawdzić, czy robot pobiera elementy poprawnie?

Poprawność ocenia się po wyniku, a nie po samej próbie wykonania ruchu lub zapytania. Robot może zamknąć chwytak i nic nie podnieść. Skrypt może pobrać stronę i nadal zapisać błędne dane. Dlatego potrzebne są mierzalne kryteria akceptacji.

- Uruchom serię testową na różnych typach elementów.

- Porównaj wynik pobrania z listą oczekiwaną.

- Sprawdź błędy chwytu, kolizje, braki danych i duplikaty.

- Zmierz czas od detekcji do potwierdzenia sukcesu.

- Zapisz przypadki graniczne, które psują wynik.

- Wprowadź poprawki i powtórz test na tej samej próbce.

W robotyce przemysłowej liczy się skuteczność picku, powtarzalność pozycji odkładania, czas cyklu, liczba kolizji i liczba interwencji operatora. W środowisku webowym kontrola obejmuje kompletność rekordów, zgodność ze schematem danych, liczbę duplikatów, udział pustych pól i stabilność procesu w czasie.

Z mojego doświadczenia najlepiej działają krótkie testy cykliczne z logowaniem każdego przypadku błędu. Pojedynczy udany przebieg cieszy, ale niewiele mówi. Dopiero seria na zróżnicowanych danych pokazuje, czy system umie pracować stabilnie, czy tylko miał dobry dzień.

Najwięcej o jakości wdrożenia mówią trzy wskaźniki: stabilność, powtarzalność i czas reakcji. Gdy te parametry trzymają poziom, system zwykle nadaje się do realnej pracy. Gdy którykolwiek z nich pływa, później pływa cały proces.

Podsumowanie

Pobieranie elementów przez roboty obejmuje zarówno bin picking, jak i web scraping, dlatego zawsze wymaga poprawnej identyfikacji, selekcji celu i potwierdzenia efektu. W praktyce o skuteczności decydują jakość danych wejściowych, dobór sensorów lub źródła danych, logika odrzucania błędnych kandydatów, bezkolizyjne planowanie ruchu albo odporna obsługa sesji i struktury strony. Gdy system ma dobrze ustawioną percepcję, weryfikację i testy graniczne, pracuje szybciej, pewniej i z mniejszą liczbą awarii.

Jeśli chcesz wdrożyć takie rozwiązanie, zacznij od prostego scenariusza i dopiero potem zwiększaj złożoność.

FAQ

Q: Czy pobieranie elementów przez roboty wymaga zawsze wizji 3D?

A: Nie. Przy prostych detalach lub statycznych stronach wystarczy czujnik obecności, selektor HTML albo API. Wizja 3D staje się potrzebna, gdy obiekty leżą chaotycznie, są częściowo zasłonięte albo zmieniają pozycję.

Q: Czy web scraping i RPA to to samo?

A: Nie. Web scraping pobiera dane ze stron, a RPA odtwarza kroki użytkownika w aplikacji. Oba podejścia mogą się uzupełniać, lecz mają inny poziom elastyczności i inny koszt utrzymania.

Q: Jakie dane najlepiej nadają się do pobierania przez API?

A: Dane o stałej strukturze, takie jak ceny, stany magazynowe, listy produktów i rekordy transakcyjne. API daje porządek, łatwiejszą walidację i mniej błędów niż parsowanie niestabilnego HTML.

Q: Kiedy robot przemysłowy powinien odrzucić detal?

A: Gdy chwytalność spada, detal zasłania inny obiekt, trajektoria grozi kolizją albo pozycja nie mieści się w tolerancji systemu. Lepiej pominąć trudny obiekt niż uszkodzić chwytak lub pojemnik.

Q: Jak odróżnić bot ruchu sieciowego od zwykłego użytkownika?

A: Patrz na tempo żądań, powtarzalność ścieżek, brak opóźnień między akcjami i nietypowe nagłówki. Sam jeden sygnał nic nie przesądza, ale zestaw wzorców pozwala wykryć automatyzację z dużą trafnością.

Weryfikacja i redakcja

Za redakcję i weryfikację artykułu odpowiadają:

Joanna Lewandowska. Specjalistka ds. automatyki i integracji. Absolwentka kierunku Automatyka i Robotyka na Akademii Górniczo-Hutniczej im. Stanisława Staszica w Krakowie.

Piotr Woźniak. Doświadczony redaktor technologiczny. Absolwent kierunku Dziennikarstwo i Komunikacja Społeczna na Uniwersytecie Warszawskim.

Opublikuj komentarz